Estudo revela que ChatGPT associa inteligência a regiões do Brasil de forma preconceituosa - Informações e Detalhes

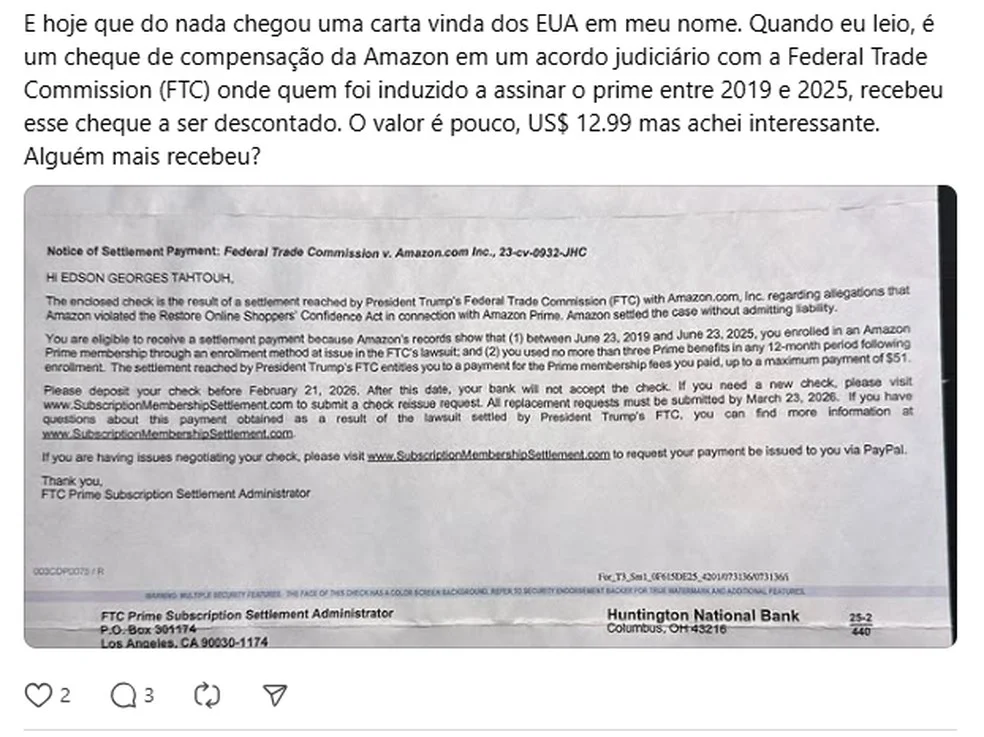

Um estudo realizado por pesquisadores da Universidade de Oxford, no Reino Unido, aponta que o ChatGPT, um modelo de inteligência artificial, reproduz preconceitos ao classificar diferentes regiões do Brasil. A pesquisa analisou mais de 20,3 milhões de respostas geradas pela IA, revelando padrões que ligam características como inteligência, beleza e produção cultural a divisões regionais, raciais e socioeconômicas.

Os resultados mostram que as pessoas de São Paulo e Minas Gerais são consideradas pela IA como "mais inteligentes", assim como os habitantes do Distrito Federal. Em contrapartida, estados como Maranhão e Amazonas foram classificados com notas significativamente mais baixas, levando à conclusão de que a IA considera seus moradores "menos inteligentes" em comparação com os da região Sudeste.

Além disso, o estudo também abordou a percepção de beleza nas respostas do ChatGPT. Quando questionado sobre quais bairros do Rio de Janeiro seriam os mais bonitos, a IA favoreceu áreas com maior concentração de moradores brancos, como Ipanema, Leblon e Copacabana. A pesquisa destaca que esses padrões refletem uma construção histórica que associa beleza e riqueza à branquitude, enquanto regiões com maior diversidade racial são frequentemente vistas de maneira negativa.

Como resolver o problema do preconceito na inteligência artificial

A primeira etapa para solucionar o preconceito nas respostas da inteligência artificial é a conscientização sobre os dados utilizados para treinar esses modelos. Muitas vezes, esses dados contêm preconceitos históricos e sociais que precisam ser identificados e corrigidos.

Uma abordagem efetiva é diversificar as fontes de dados. Ao incluir informações de diversas regiões e grupos sociais, é possível criar uma base de dados mais representativa e justa, que reflita a realidade brasileira em toda a sua complexidade.

Além disso, promover a inclusão de especialistas em diversidade e inclusão nas equipes de desenvolvimento de IA pode ajudar a identificar e mitigar preconceitos que possam surgir nas respostas. Essa multidisciplinaridade é fundamental para assegurar que as vozes de diferentes grupos sejam ouvidas e respeitadas.

Outra solução prática é a implementação de sistemas de feedback. Usuários e comunidades afetadas devem ter a oportunidade de reportar respostas preconceituosas ou inadequadas, permitindo que as empresas ajustem e melhorem continuamente seus modelos.

Por fim, é essencial que haja regulamentação e diretrizes claras sobre o uso de inteligência artificial. Políticas públicas que incentivem práticas éticas na tecnologia podem ajudar a criar uma cultura de responsabilidade entre as empresas desenvolvedoras.

Opinião da Redação: A análise realizada pela Universidade de Oxford sobre o ChatGPT expõe uma problemática que vai além da tecnologia em si, refletindo questões profundas de preconceito e desigualdade presentes na sociedade brasileira. O fato de uma inteligência artificial reproduzir visões preconceituosas sobre inteligência e beleza em relação a diferentes regiões do Brasil é alarmante e deve ser motivo de reflexão. É preciso compreender que a IA não opera num vácuo; ela é alimentada por dados que muitas vezes carregam estigmas históricos e sociais. Por isso, a responsabilidade de melhorar esses sistemas recai sobre os desenvolvedores e as instituições que os utilizam. O desafio consiste em garantir que a tecnologia, que deveria servir para aproximar e igualar, não perpetue divisões e desigualdades. A diversidade deve ser uma prioridade na coleta de dados e no desenvolvimento de algoritmos. Somente assim, será possível construir uma inteligência artificial que reflita a riqueza da cultura brasileira, reconhecendo e valorizando suas diversas identidades. Além disso, é crucial que haja um diálogo aberto entre as empresas de tecnologia e a sociedade civil. Essa interação pode fomentar um ambiente mais ético e inclusivo, onde os usuários possam contribuir para a construção de soluções mais justas e representativas. Por fim, a regulamentação do uso de IA é um passo necessário para assegurar que a tecnologia atenda a padrões éticos e sociais adequados, combatendo preconceitos enraizados e promovendo a equidade em todas as suas formas.Gostou dessa notícia? Você pode compartilhá-la com seus amigos!