Vídeo falso de Marcos Palmeira pede doações para o caso do cão Orelha; golpe utiliza IA - Informações e Detalhes

Um vídeo que circula nas redes sociais usa a imagem do ator Marcos Palmeira para pedir doações em uma campanha relacionada ao caso do cão Orelha, que foi sacrificado devido a agressões que sofreu. Este conteúdo é, na verdade, uma fraude. A assessoria do ator confirmou que se trata de um golpe, criado com o auxílio de inteligência artificial (IA) para manipular tanto a imagem quanto o áudio.

O vídeo, que ganhou destaque principalmente no Facebook e Instagram, explora a comoção gerada pela morte do cachorro, que era conhecido na Praia Brava, em Florianópolis. O animal precisou passar por eutanásia no início de janeiro, após ser brutalmente agredido. Recentemente, a Polícia Civil de Santa Catarina identificou um adolescente como responsável pela agressão e solicitou a internação provisória do jovem.

A publicação falsa apresenta uma imagem de Marcos Palmeira falando diretamente à câmera, com um apelo emocional intenso. Em seu discurso, o ator, supostamente, convoca as pessoas a ajudarem a responsabilizar os agressores, mencionando que a campanha precisa de apoio urgente. "Temos menos de 7 dias para garantir que esse caso não seja esquecido", diz a gravação adulterada.

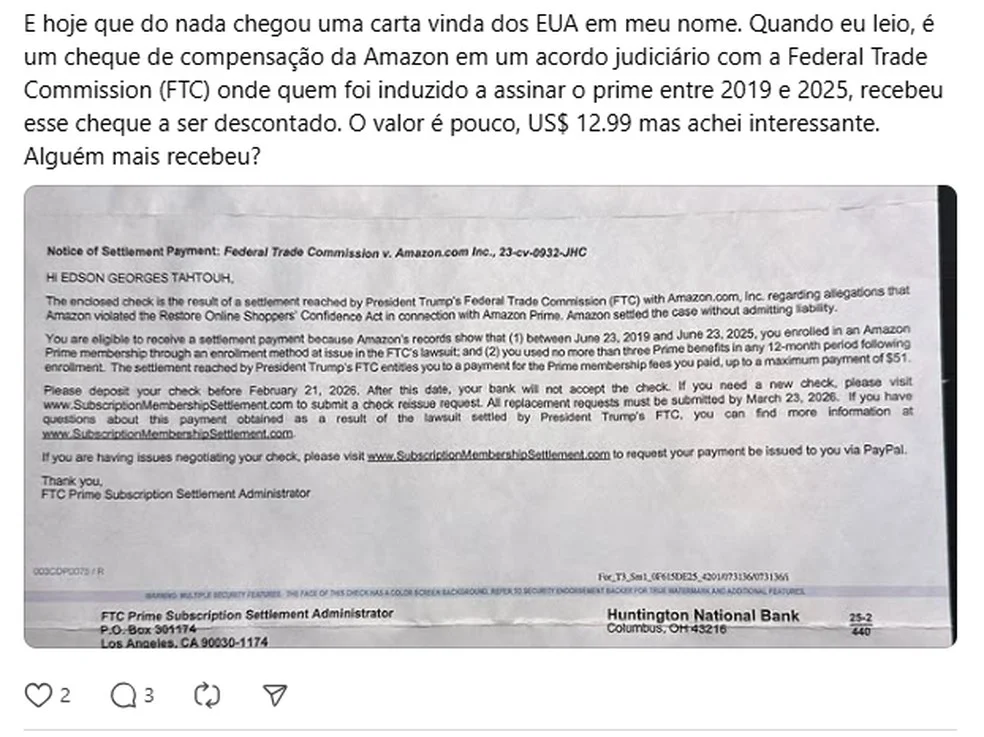

O vídeo ainda inclui um link que direciona os internautas para uma página de arrecadação online, onde são solicitadas doações que variam de R$ 30 a R$ 1 mil. No entanto, a análise do site revela indícios de fraude, como a ausência de informações básicas sobre a campanha, como CNPJ e endereço físico, e a exigência de pagamentos via PIX, o que compromete a transparência da operação.

Além disso, a assessoria de Marcos Palmeira divulgou um comunicado alertando sobre o uso indevido de sua imagem. O ator descreveu a situação como uma prática sórdida, que deve ser denunciada e combatida, especialmente em um ano eleitoral, quando a desinformação tende a aumentar.

Testes realizados com ferramentas de verificação de deepfake indicaram que o vídeo possui uma alta probabilidade de ter sido manipulado. O detector de deepfake da plataforma InVID apontou 98% de chance de adulteração, enquanto a ferramenta Hiya, que analisa áudios, detectou 92% de probabilidade de geração por inteligência artificial.

Gostou dessa notícia? Você pode compartilhá-la com seus amigos!