Influenciadora de Ética em Inteligência Artificial Perde Contas em Redes Sociais - Informações e Detalhes

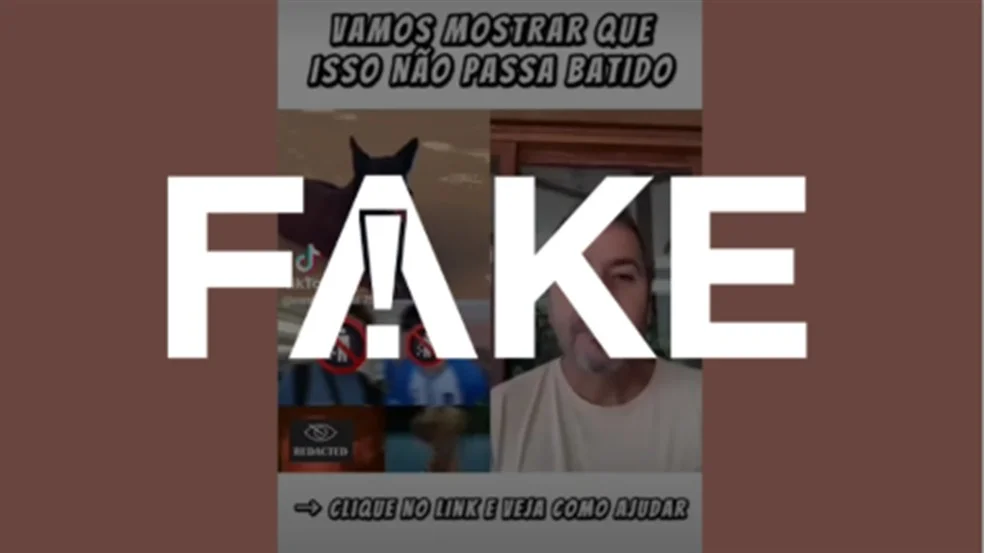

Catharina Doria, uma influenciadora que se destacou no tema de ética em inteligência artificial, enfrenta dificuldades após ter suas contas em redes sociais suspensas. Com uma audiência de quase 600 mil seguidores, ela produzia vídeos abordando temas como a diferenciação entre imagens reais e aquelas geradas por inteligência artificial. Além disso, seus conteúdos alertavam sobre os cuidados que pais devem ter ao compartilhar fotos de seus filhos na internet.

Recentemente, Doria teve duas contas derrubadas, o que pode estar relacionado ao foco de seu trabalho nas implicações das decisões automatizadas. Em suas redes sociais, a influenciadora expressou sua preocupação ao afirmar: "É trágico que uma especialista em IA ética tenha sua vida afetada por uma IA".

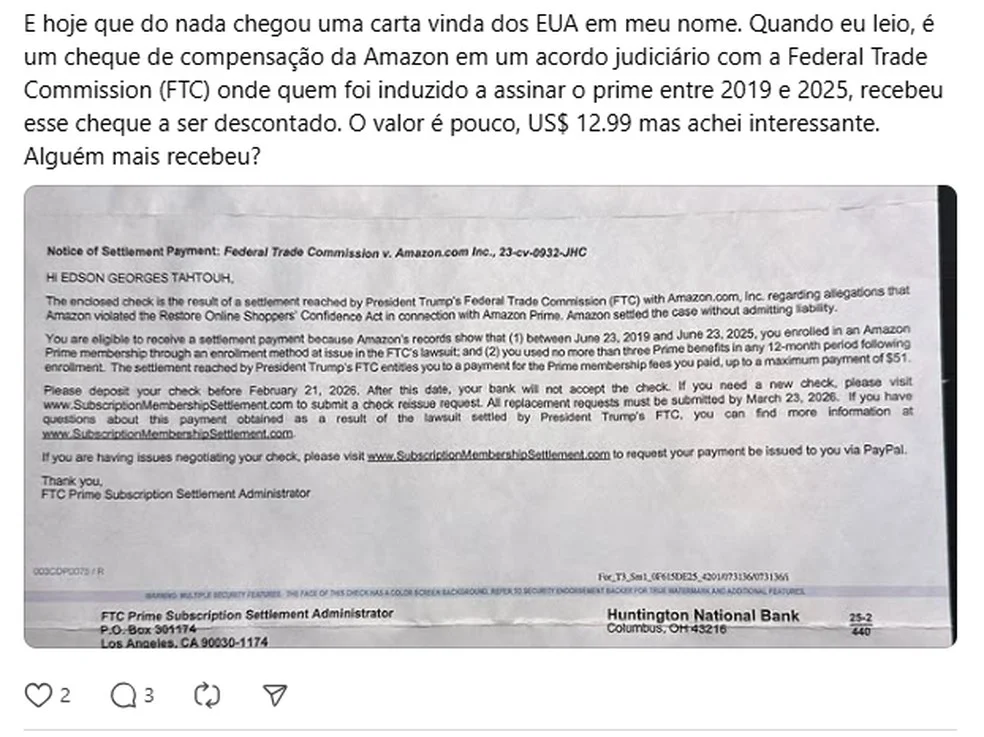

No fim de março, Catharina adotou uma cadela resgatada e, a pedido de seus seguidores, decidiu criar um perfil para o animal. No entanto, assim que tentou criar a conta, recebeu uma notificação de que ela havia sido banida por violar as diretrizes da Meta, a empresa controladora do Instagram. "A conta nasceu morta", lamentou ela, explicando que não conseguiu nem mesmo publicar uma foto ou uma biografia.

A influenciadora mostrou um e-mail do Instagram que informava sobre a suspensão da conta, alegando violação das "Diretrizes da comunidade sobre integridade de conta". Mesmo após abrir um recurso e enviar documentos de identificação, Doria recebeu uma resposta negativa da plataforma, que não detalhou o motivo da recusa.

Em maio, ela foi informada sobre a suspensão de uma segunda conta, a @theaisurvivalclub, que era usada para discutir letramento crítico em inteligência artificial. A justificativa dada pela Meta foi de que essa conta estava associada a outra que havia infringido regras da empresa.

"Trabalho com isso, é minha fonte de renda e credibilidade. É assustador saber que uma inteligência artificial pode acabar com meu sustento", desabafou Doria. Sua conta principal, @cahdoria, permanece ativa, mas a influenciadora teme que também possa ser banida.

A Meta, ao ser procurada, não se manifestou sobre o caso e não esclareceu se houve uma revisão humana nas decisões de suspensão das contas.

O advogado e pesquisador de Harvard, Caio Vieira Machado, destacou a importância da transparência nas decisões tomadas por algoritmos. Ele afirmou que o sistema atual é inconstante e que os usuários não têm acesso claro sobre como as decisões são feitas. "A opacidade das decisões é um grande problema. O algoritmo pode ter interpretado algo errado e sinalizado uma conta como problemática sem que haja um motivo real para isso", explicou.

Machado ressaltou que, devido à escala global em que esses sistemas operam, os erros se multiplicam rapidamente. Um erro que atinge 1% pode resultar em milhões de contas afetadas. Para ele, a solução ideal seria garantir que as decisões automatizadas pudessem ser revisadas por humanos, evitando falsos positivos.

Ele ainda fez referência à Lei Geral de Proteção de Dados (LGPD), que garante aos cidadãos o direito de solicitar a revisão de decisões automatizadas que impactem seus interesses. Contudo, na prática, os revisores muitas vezes são contratados em grande número, com baixos salários, e trabalham sob pressão, sendo forçados a avaliar publicações em um tempo extremamente curto.

Desta forma, a situação enfrentada por Catharina Doria levanta questionamentos importantes sobre a eficácia e a ética dos algoritmos que regem as redes sociais. A falta de clareza nas diretrizes e a ausência de um canal efetivo para contestação podem prejudicar não apenas influenciadores, mas qualquer usuário comum.

Em resumo, a opacidade nas decisões automatizadas é um problema que merece atenção. A fragilidade das contas e a possibilidade de suspensões indevidas podem gerar consequências severas na vida profissional e pessoal de quem utiliza essas plataformas.

Assim, é fundamental que as empresas de tecnologia, como a Meta, revejam suas políticas e garantam um processo mais transparente e justo para seus usuários. A revisão humana nas decisões automatizadas é uma necessidade urgente que deve ser implementada.

Finalmente, a discussão sobre ética em inteligência artificial não pode se restringir aos especialistas. É essencial que a sociedade como um todo se envolva nesse debate, buscando soluções que garantam o respeito aos direitos dos indivíduos nas plataformas digitais.

Uma Dica Especial para Você!

Após o polêmico episódio envolvendo a influenciadora Catharina Doria e as questões de opacidade nas decisões automatizadas, é hora de trazermos clareza e controle ao seu espaço. Para isso, apresentamos a Fonte de Alimentação 12v 2a Bivolt Estabilizada para Fita Led e, a solução perfeita para iluminar seus projetos com segurança e eficiência.

Com esta fonte de alimentação, você garante a energia ideal para suas fitas LED, promovendo uma iluminação impecável e constante. Seu design estabilizado assegura que seus dispositivos funcionem de maneira otimizada, evitando falhas e proporcionando um ambiente mais acolhedor e produtivo. Sinta a diferença em cada canto da sua casa ou oficina!

Não perca essa oportunidade de transformar seu espaço e garantir uma iluminação perfeita! Estoque limitado, então é hora de agir. Adquira agora a sua Fonte de Alimentação 12v 2a Bivolt Estabilizada para Fita Led e e faça a escolha certa para o seu projeto!

Gostou dessa notícia? Você pode compartilhá-la com seus amigos!