Plataformas digitais implementam verificação de idade com selfie para proteger crianças e adolescentes - Informações e Detalhes

Nos últimos meses, várias plataformas digitais como Roblox, Discord, YouTube, TikTok e ChatGPT anunciaram a implementação de um sistema de verificação de idade que exige a envio de uma selfie ou de documentos de identificação dos usuários. Essa decisão foi motivada pela crescente pressão de governos e organizações em todo o mundo para restringir o acesso de crianças e adolescentes a conteúdos potencialmente prejudiciais nas redes sociais.

Essas mudanças surgem em um contexto de preocupações sobre a saúde mental dos jovens. Nos Estados Unidos, empresas como Meta (controladora do Instagram e Facebook) e Google (dono do YouTube) enfrentam processos judiciais relacionados ao impacto negativo que suas plataformas podem ter causado na saúde mental de crianças. No Brasil, a situação é semelhante, já que o ECA Digital, que entra em vigor em março, exige que plataformas verifiquem a idade dos usuários para conteúdos inadequados para menores de 16 anos.

A verificação de idade tem sido um tema recorrente nas discussões sobre segurança online. A medida mais recente foi anunciada pelo Discord, que indicou que a partir de março, todos os usuários poderão ser solicitados a passar pela verificação ao tentarem alterar configurações de segurança ou acessar conteúdos sensíveis. O YouTube e a OpenAI, que controla o ChatGPT, também informaram sobre a adoção de sistemas que visam identificar menores de idade e oferecer proteções adicionais.

O TikTok já começou a implementar a verificação de idade, embora, por enquanto, apenas na Europa. Em janeiro, o Roblox também introduziu uma verificação de idade para permitir o uso do chat, o que gerou protestos virtuais entre os usuários, que expressaram sua indignação com frases como "Quero injustiça". Essa reação é um reflexo da resistência de parte da comunidade jovem em relação a restrições que limitam suas experiências online.

As novas medidas de verificação de idade estão sendo implantadas em resposta a uma crescente pressão global por um controle mais rigoroso sobre o acesso de crianças a plataformas digitais. Em diversos países, como a Austrália, menores de 16 anos têm sido proibidos de acessar serviços como Instagram e TikTok, o que tem gerado um debate sobre a responsabilidade das empresas em proteger os usuários mais jovens.

No Brasil, a discussão sobre a verificação de idade é particularmente relevante, uma vez que a legislação exige que plataformas realizem essa verificação para evitar que crianças e adolescentes tenham acesso a conteúdos impróprios. Laís Peretto, diretora-executiva da Childhood Brasil, destacou que as empresas estão tentando se antecipar às regulações que estão sendo implementadas nos países, em um movimento que reflete a necessidade de maior responsabilidade na proteção dos jovens online.

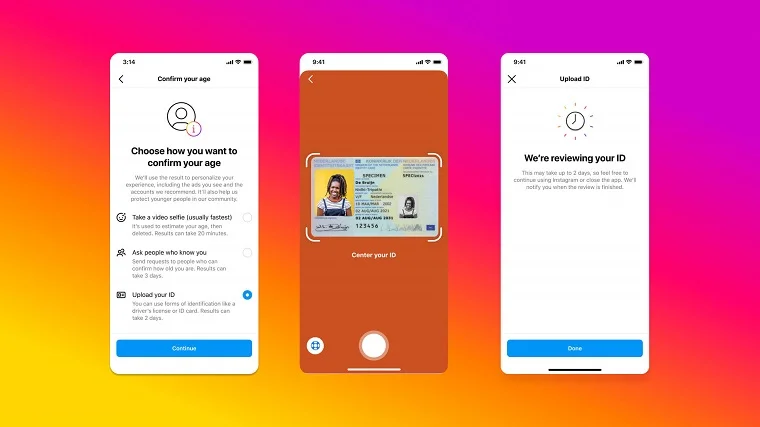

A verificação de idade pode ser feita de várias formas. Plataformas como TikTok, ChatGPT e YouTube utilizam inteligência artificial para analisar o comportamento dos usuários e estimar sua idade. Por outro lado, Roblox e Discord realizam a verificação quando os usuários tentam acessar recursos considerados arriscados para sua segurança. Entre os métodos de verificação, destacam-se a selfie, a autorização via cartão de crédito e a apresentação de documentos de identidade.

A ferramenta desenvolvida pela Persona, utilizada pelo Roblox e ChatGPT, analisa características faciais para comparar a selfie com a foto de um documento de identidade. O TikTok utiliza a tecnologia da Yoti, enquanto o Discord adota um sistema da k-ID. A Persona também alertou sobre os desafios que a verificação de identidade enfrenta, como a possibilidade de fraudes por meio de deepfakes, que podem burlar esses sistemas de verificação.

Desta forma, a implementação da verificação de idade nas plataformas digitais é uma resposta necessária às preocupações crescentes sobre a segurança de crianças e adolescentes. À medida que o acesso a conteúdos potencialmente prejudiciais se torna mais fácil, é fundamental que as empresas tomem medidas proativas para proteger seus usuários mais jovens.

Em resumo, a responsabilidade das plataformas não deve se restringir apenas à adoção de tecnologias de verificação. É essencial que haja um diálogo aberto com os pais e responsáveis, além de uma transparência maior sobre as políticas de segurança e privacidade adotadas.

Assim, a verificação de idade pode ser um passo importante, mas deve ser complementada por outras ações que promovam um ambiente digital mais seguro. A educação digital e a conscientização sobre os riscos online também são fundamentais para garantir que crianças e adolescentes naveguem de forma segura.

Por fim, é crucial que as plataformas encontrem um equilíbrio entre a proteção dos dados dos usuários e a eficácia das suas medidas de segurança. O desafio será garantir que as tecnologias utilizadas sejam realmente eficazes e que não comprometam a privacidade dos usuários.

Gostou dessa notícia? Você pode compartilhá-la com seus amigos!