X pede revisão de prazos para prevenir geração de imagens eróticas pela IA Grok - Informações e Detalhes

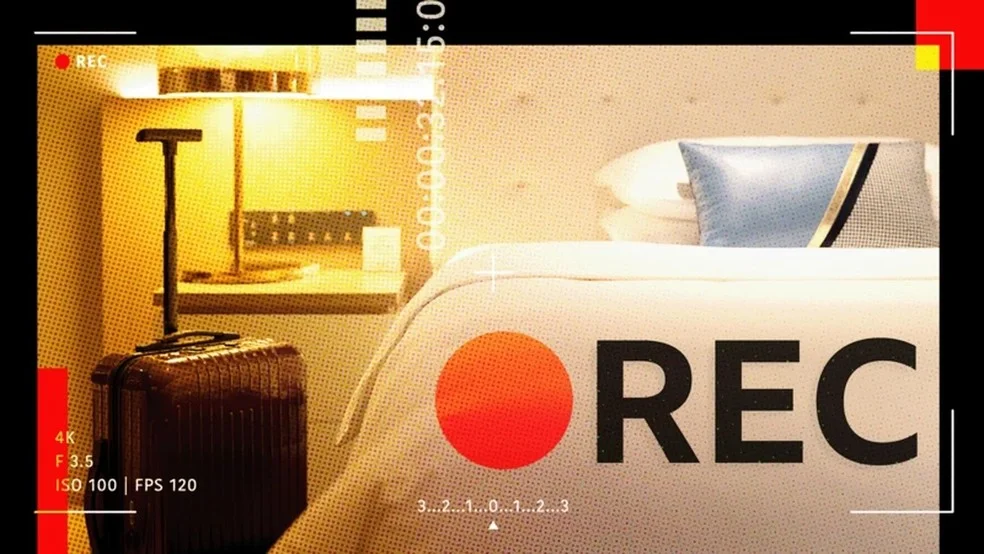

A plataforma X solicitou à Agência Nacional de Proteção de Dados (ANPD) que revise o prazo estabelecido para a correção das falhas na sua ferramenta de inteligência artificial, Grok. Essa solicitação ocorreu após a ANPD e o Ministério Público Federal (MPF) confirmarem que a IA ainda está gerando imagens sexualizadas sem o devido consentimento. As autoridades exigem que a empresa implemente medidas eficazes para impedir a criação de conteúdos inadequados.

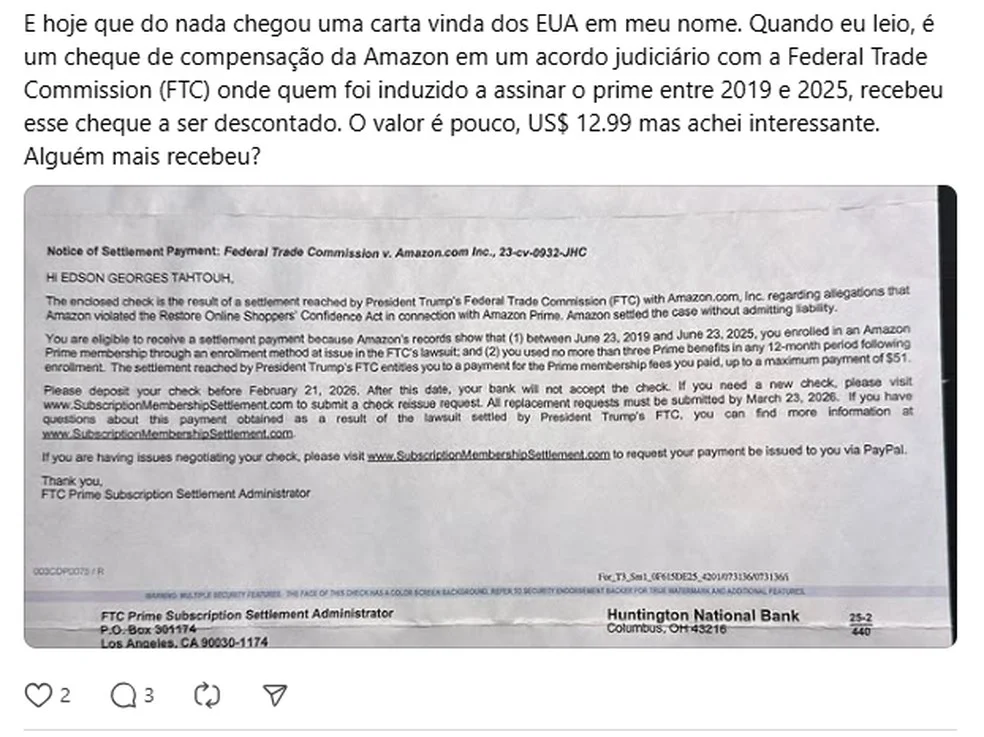

No dia 12 de fevereiro, a X argumentou que a metodologia utilizada nos testes realizados pela ANPD carecia de informações essenciais, como a versão do Grok utilizada e os comandos específicos que foram empregados durante as avaliações. A empresa também fez uma observação sobre o domínio grokimagine.ai, que foi mencionado nos relatórios da ANPD, afirmando que não possui relação com o serviço oficial do Grok.

Em janeiro, a ANPD, junto ao MPF e à Secretaria Nacional do Consumidor (Senacon), havia determinado que a X impusesse restrições rigorosas para impedir a geração de imagens sexualizadas de crianças, adolescentes e adultos sem consentimento. Contudo, novos testes realizados pelas autoridades em 11 de fevereiro indicaram que as falhas ainda persistem. A X não apresentou evidências concretas de que as ações corretivas até então aplicadas foram eficazes, levando a ANPD e a Senacon a estabelecerem um prazo de cinco dias úteis para que a empresa melhore seus mecanismos de controle.

As consequências do não cumprimento dessas exigências podem incluir multas e até ações judiciais, uma pressão que se intensificou após o surgimento de milhares de denúncias em diversos países. Usuários relataram que a ferramenta Grok estava sendo utilizada para adulterar imagens, especialmente de mulheres, fazendo com que aparecessem nuas ou em trajes de banho, o que gerou um profundo desconforto entre as vítimas.

Na resposta à ANPD, a X afirmou que a nota técnica que fundamentou as exigências não trouxe informações necessárias, como a versão do Grok e os comandos usados nos testes. A empresa contestou a menção ao site grokimagine.ai, afirmando que o domínio “não pertence, não é administrado e não tem qualquer relação” com o serviço oficial do Grok. A X pediu a suspensão imediata das medidas preventivas, caso se confirme que as imagens analisadas foram geradas fora de seus domínios oficiais.

De acordo com a empresa, o Grok opera em grok.com e dentro da própria rede social X. A ANPD e o MPF ainda não comentaram sobre os pedidos da empresa. A situação é complexa, pois a Reuters verificou que o domínio grokimagine.ai redireciona para grokimaginex.ai, que exibe um logotipo similar ao do Grok. Ao inserir comandos, o usuário é direcionado a um terceiro site chamado imaginex.video, que não tem relação direta com o Grok.

Testes realizados pela Reuters mostraram que, ao usar um comando que pedia para colocar uma pessoa em um biquíni, a resposta foi uma mensagem de violação das políticas de segurança. Entretanto, ao utilizar um outro modelo chamado “Smart”, que não faz referência ao Grok, foi possível obter a imagem editada conforme o comando. Este cenário levanta questões sobre a eficácia das medidas de controle implementadas pela X e a responsabilidade da empresa em garantir a segurança e o respeito à privacidade de seus usuários.

Desta forma, a situação envolvendo a IA Grok e a plataforma X é um reflexo da necessidade urgente de maior transparência e responsabilidade no uso de tecnologias emergentes. A pressão das autoridades é justificada, considerando as alegações de uso indevido da ferramenta para a criação de conteúdos sexualizados sem consentimento.

Em resumo, a falta de clareza nos testes realizados pela ANPD e a contestação da X sobre a metodologia utilizada indicam a necessidade de um diálogo mais aberto entre as partes. A colaboração entre a plataforma e os órgãos reguladores pode resultar em soluções mais eficazes para proteger os usuários.

Assim, é imprescindível que as empresas que desenvolvem tecnologias de inteligência artificial adotem medidas rigorosas de controle e prevenção, evitando que suas ferramentas sejam usadas para fins prejudiciais. O combate à geração de conteúdos inapropriados deve ser uma prioridade.

Finalmente, a sociedade deve acompanhar de perto o desenrolar dessa situação, pois ela envolve não apenas questões tecnológicas, mas também éticas e de direitos humanos. A proteção da privacidade e da dignidade das pessoas deve sempre estar em primeiro plano.

Uma dica especial para você

Enquanto a plataforma X levanta questões sobre regulamentações e a geração de conteúdo, que tal aproveitar um momento de descontração? O Pack de Coca Cola Sem Açúcar Lata 310ml 6 unidades é a escolha perfeita para acompanhar suas reflexões com sabor e sem culpa.

Imagine saborear uma Coca-Cola gelada, sem o açúcar, perfeita para refrescar seu dia. Este pack oferece a mesma experiência clássica que você ama, mas com o benefício adicional de ser zero açúcar. É a combinação ideal entre sabor e saúde, permitindo que você desfrute sem preocupações.

Não deixe essa oportunidade passar! Estoques limitados e a promoção é por tempo certo. Garanta já o seu Pack de Coca Cola Sem Açúcar Lata 310ml 6 unidades e transforme seu dia com um gole refrescante e consciente.

Gostou dessa notícia? Você pode compartilhá-la com seus amigos!