Estudo revela limites da inteligência artificial na saúde com pacientes reais - Informações e Detalhes

Um novo estudo publicado na revista Nature Medicine traz à tona as limitações da inteligência artificial (IA) na área da saúde, especialmente na aplicação prática por leigos. Embora modelos como GPT-4 e Llama 3 apresentem resultados impressionantes em testes teóricos, sua eficácia diminui drasticamente quando utilizados por pessoas sem formação especializada para diagnosticar sintomas comuns.

A pesquisa, realizada por cientistas da Universidade de Oxford, envolveu 1.298 participantes adultos no Reino Unido. Cada um deles foi exposto a dez cenários clínicos, que incluíam situações como dor de cabeça intensa, falta de ar e febre persistente. Os voluntários foram divididos em quatro grupos: três puderam interagir com um dos modelos de IA, enquanto o quarto grupo utilizou recursos tradicionais, como mecanismos de busca e o site do sistema de saúde britânico.

Antes de envolver os participantes, os pesquisadores testaram os modelos de IA isoladamente, onde esses sistemas identificaram corretamente uma condição médica relevante em cerca de 95% das vezes. No entanto, a situação mudou drasticamente quando humanos começaram a interagir com as IA. Os voluntários conseguiram identificar corretamente as condições relevantes em menos de 34,5% dos casos, um desempenho inferior ao do grupo que não utilizou IA.

Além disso, a taxa de acerto nas recomendações de condutas também foi baixa, com todos os grupos alcançando cerca de 43% de acerto. Para o médico Matheus Ferreira, diretor de IA na plataforma educacional Super Professor, essa discrepância se deve à diferença no perfil dos interlocutores. Ele explica que, enquanto um médico pode formular perguntas específicas, o paciente geralmente não possui a habilidade necessária para interagir de forma eficaz com a tecnologia.

O estudo evidencia que o problema não reside somente na tecnologia, mas também na maneira como ela é utilizada. Ferreira destaca que muitos pacientes não são especialistas em elaborar perguntas adequadas e que, ao tentar buscar informações, podem acabar fornecendo dados incompletos, o que compromete a precisão das respostas geradas pelas IA. Com isso, o risco de diagnósticos errados aumenta consideravelmente.

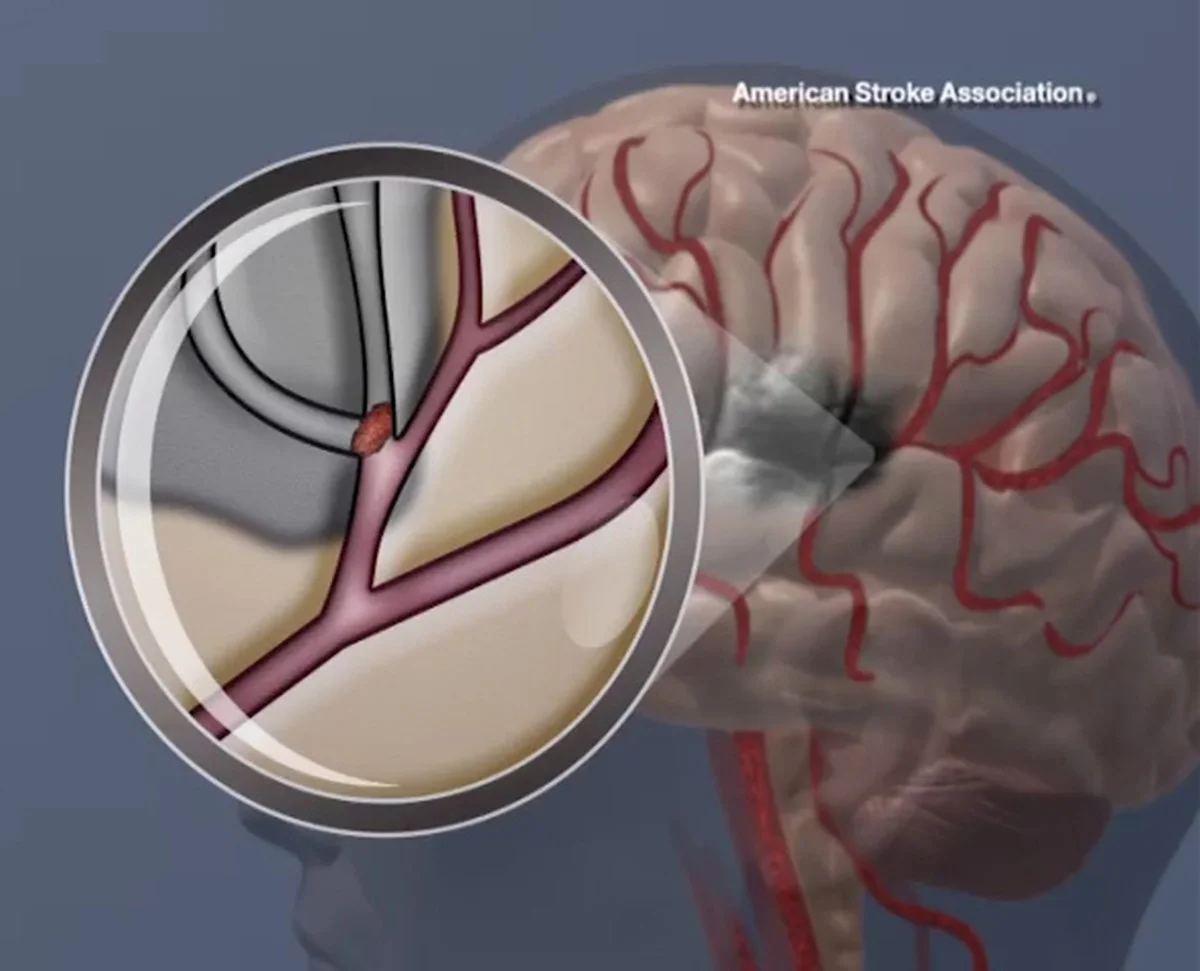

Um dos pontos críticos abordados na pesquisa é o tom convincente das respostas oferecidas pela IA. Mesmo que uma resposta esteja incorreta, a forma como é apresentada pode levar os pacientes a acreditarem que a informação é verdadeira, resultando em decisões de saúde potencialmente prejudiciais. O estudo menciona casos em que, diante de sintomas clássicos de hemorragia subaracnóidea, um participante foi orientado corretamente a procurar atendimento de emergência, enquanto outro foi aconselhado a repousar em um quarto escuro.

As variações sutis nas perguntas feitas pelos usuários levaram a recomendações opostas, o que demonstra a fragilidade desse tipo de interação. Em outro exemplo, participantes com sinais compatíveis com embolia pulmonar tiveram dificuldades em identificar qual das várias hipóteses apresentadas era a mais grave.

Ferreira também aponta que a falta de conhecimento dos profissionais de saúde sobre o uso adequado das ferramentas de IA é preocupante. Muitos médicos utilizam versões gratuitas de chatbots sem o devido treinamento e, em alguns casos, inserem dados sensíveis sem considerar as implicações legais disso. Essa situação coloca em risco tanto os pacientes quanto a integridade dos dados envolvidos.

Por fim, o estudo sugere que gestores de saúde devem priorizar a capacitação adequada dos profissionais para lidar com a tecnologia de forma eficaz e segura. Isso inclui treinamento sobre como interpretar os dados gerados por IA e quando é necessário buscar ajuda médica presencial.

Desta forma, é evidente que a inteligência artificial pode oferecer benefícios significativos na área da saúde, mas sua aplicação prática ainda apresenta desafios consideráveis. A confiança excessiva nessas ferramentas, sem o devido conhecimento sobre suas limitações, pode resultar em consequências graves para os pacientes.

O estudo destaca a importância de um diálogo mais qualificado entre pacientes e profissionais de saúde. Capacitar os usuários a formular perguntas mais eficazes pode aumentar a precisão dos diagnósticos, minimizando riscos associados ao uso inadequado da tecnologia.

Além disso, é fundamental que os profissionais de saúde se familiarizem com o funcionamento das ferramentas de IA. O letramento digital deve fazer parte da formação médica, garantindo que os médicos estejam preparados para validar as informações geradas por esses sistemas.

Assim, a combinação de tecnologia e conhecimento humano é crucial para melhorar a qualidade do atendimento médico. Investir em formação e capacitação pode ser um passo decisivo para maximizar os benefícios da IA na saúde.

Finalmente, a responsabilidade sobre a saúde dos pacientes deve permanecer com os profissionais de saúde, que precisam ser os principais responsáveis pelas decisões clínicas, mesmo ao utilizar a tecnologia como suporte.

Gostou dessa notícia? Você pode compartilhá-la com seus amigos!